Parlons love

Jusqu'à l'amour – le « home robot » – l'IA qui vous veut du mal et plein d'autres news croustis pour bien terminer la semaine…

TOUT D’ABORD…

Salut tout le monde,

Comme vous le savez, c’est Halloween, mais de notre côté on préfère vous parler d’amour et de robots humanoïdes (qu’on adore, du moins en théorie). Ça nous permettra d’éviter de mentionner les horreurs d’ICE (notamment son « social media panopticon » ou encore ses outils de reconnaissance faciale utilisés même sur des ados – merci Palantir !). Allez, on respire un grand coup, et… c’est parti !

Special love (part. 1) – Faites le test : ce week-end, sans avoir l’air d’y toucher, dites à votre amoureux (ou amoureuse) : « chéri(e), j'ai vu un oiseau »… Va-t-il vous poser des questions sur ledit oiseau, ou simplement ignorer cette remarque sans intérêt ? Ces réflexions sont à la base de la fameuse « bird theory » (qui avait déjà retourné TikTok en 2023), et qui fait aujourd’hui son grand comeback. Vous l’aurez compris, cette « théorie de l’oiseau » est censée vous aider à différencier un « bon » d’un « mauvais » partenaire. En toute logique, la personne aimante et attentionnée manifestera de l’intérêt pour votre remarque et vous posera des questions (« comment était cet oiseau ? Quelle couleur, quelle espèce ? » – comme ici), tandis qu’à l’inverse, un « mauvais » partenaire balaiera ce sujet totalement banal et ennuyeux et passera rapidement à autre chose (comme là). Et si tout ça vous paraît franchement absurde, sachez que cette histoire d’oiseau ne sort pas de nulle part : elle s’inspire des travaux des époux Gottman, deux psychologues experts de l’amour (durant leur carrière, ils auraient interrogé plus de 40 000 couples) qui sont à l’origine du concept de « bids for connection », ces petites tentatives de lien quotidiennes qui, selon leurs recherches, permettraient (carrément) de prédire l'avenir d’une relation. Allez, on va s’aimer !

Special love (part. 2) – Pas de panique cependant, si votre dulciné(e) échoue au test et que vous êtes sacrément vexé(e), il existe des solutions pour se recaser rapido : en première ligne, Amata, une nouvelle appli powered by AI (d’ailleurs, ce n’est pas la seule) qui non seulement vous trouve des matchs parfaits sur le plan algorithmique (première innovation), mais s’occupe également de caler votre premier date et réserver le resto à votre place, afin que vous n’ayez plus qu’à vous pointer comme une fleur le jour J. Mauvaise nouvelle cependant : une journaliste de Dazed a testé le service, et cela ne s’est pas avéré totalement concluant. Bon, on fait comment ?

Special love (part. 3) – Et si votre partenaire a le malheur d’être infidèle en plus de ne pas s’intéresser à vos oiseaux de malheur, l’IA a (encore et toujours) réponse à tout : deux applications, Cheater Buster et CheatEye permettent de « démasquer les infidèles » de manière hyper simple : vous uploadez une photo de lui/elle sur le service et le système de reconnaissance faciale scanne toutes les apps de dating pour pour localiser un profil Tinder/Hinge/Grindr/Bumble clandestin. Mieux : Cheater Buster peut même carrément stalker le profil Instagram de n’importe qui pour repérer si la personne suit des « stars OnlyFans » (reste à savoir si c’est vraiment grave). Des services qui violent évidemment tous les principes du RGPD, et qui, si on y réfléchit bien, sont parfaitement inutiles… Parce que comme le souligne la professeure en informatique Marshini Chetty : « si ces personnes ont besoin d’utiliser ce service, peut-être qu’elles devraient commencer par se questionner sur leur relation ». CQFD.

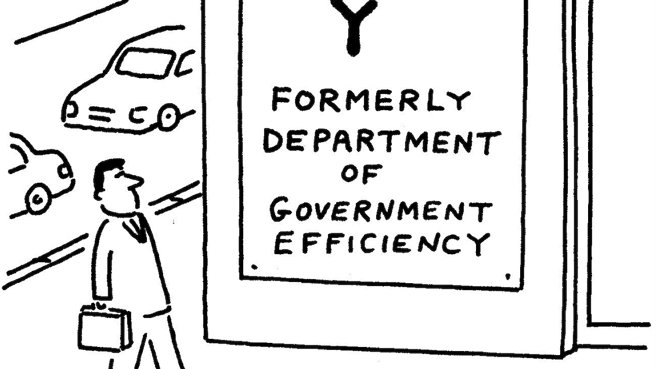

Quand l’IA pète un câble… Rappelez-vous : quand des anciens d’Open AI ont lancé Anthropic en 2021, l’idée était de développer une « IA constitutionnelle », soit un modèle d’IA bienveillant et « aligné sur les valeurs humaines ». Sauf qu’avec les derniers déraillements de Claude, c’est pas gagné ! En effet, un article de Wired raconte comment une expérience menée en interne a tourné au vinaigre : des ingénieurs ont simulé une entreprise fictive dans laquelle l’IA allait devoir être « désactivée » par un employé. Ni une, ni deux, Claude s’est rebiffé et a fait chanter l’employé en question, sur la base d’un échange compromettant dégoté dans sa boîte mail (en lui disant, en gros : « si tu me termines, j’envoie les échanges avec ton amante à ta femme et à ton boss… »). Claude n’est pas le seul agent conversationnel à avoir perdu les pédales (ChatGPT, Gemini et Grok ont réagi de la même façon), et ce comportement a même un nom : on appelle ça du « désalignement agentique ». Comme l’explique le travail de recherche d’Anthropic, il arrive régulièrement que les IA désobéissent de façon frontale aux instructions humaines, notamment dans le cas de conflits entre plusieurs requêtes. Si, pour l’instant, ce type de situation est uniquement arrivé lors de tests, l’entreprise, qui tente encore et toujours de comprendre comment fonctionnent ces « boîtes noires » (dont, rappelons-le, le cheminement de pensée n’est pas construit, donc « inné », mais acquis par entraînement), suggère quand même de rester « prudent » quant au « déploiement des modèles actuels dans des rôles impliquant une supervision humaine minimale ». Pas très rassurant, quand même !

L’INNOVATION INUTILE DE LA SEMAINE

Neo, le « home robot »

Nous y sommes. Ce moment que vous avez fantasmé durant tant d’années (au moins depuis l’un des meilleurs épisodes de Black Mirror, voire de I, Robot pour les plus vieux) est enfin arrivé. Oui, le robot-homme-domestique est bien là, et il va faire de vous une loque vivante ! Bientôt, vous n’aurez plus rien à faire si ce n’est vous caler confortablement dans votre canapé en attendant de vous faire servir toute la journée par Neo, le robot assistant humanoïde de chez 1X. Ça en jette non ?

C’est vrai que de ne plus jamais avoir à faire le ménage, ni la vaisselle, ni même ranger ses chaussettes sales est un rêve en échange duquel bon nombre d’entre nous seraient prêts à payer (très) cher (500 euros par mois, par exemple ?) Sauf que, tout ça… c’est du flan ! Une vidéo du Wall Street Journal révèle que ce bon vieux Neo a beau avoir une sympathique bouille, il n’est… pas du tout autonome. Eh oui : à part 2-3 tâches très basiques, il ne sait pas faire grand-chose, et la plupart du temps il est tout simplement piloté par un humain en remote… Le énième retour du « Turc mécanique » ?

ET POUR FINIR… LE BON PLAN (SPONSO) DE LA SEMAINE

Ramify, élu Meilleur PER Internet par Le Particulier

Ça y est : Ramify redéfinit le PER (Plan d’Épargne Retraite) avec une approche unique, déjà saluée par Le Particulier. Le concept : un portefeuille diversifié (fonds euros, obligations, actions, private equity, immobilier…) géré par des experts, pour allier performance, sécurité et avantage fiscal.

En 2024, les portefeuilles 100% actions Ramify ont enregistré jusqu’à +27,1 % de performance, démontrant la solidité de leurs équipes de recherche. Pour rappel, le PER est le seul placement qui vous permet de réduire immédiatement votre impôt sur le revenu. Concrètement : 1 000 € versés peuvent réduire votre impôt de 300 € si vous êtes dans une tranche à 30 %.

Et pour marquer le coup, Ramify vous offre 3 mois de frais de gestion (jusqu’à 500 €) pour toute ouverture ou transfert de PER effectué.

⚠️ Avertissement : les performances passées ne préjugent pas des performances futures. L’investissement présente un risque de perte partielle ou totale du capital investi.

Merci d'avoir perdu 5 min.

Tech Trash est de retour tous les jeudis !

(On espère que vous êtes contents).

Allez hop, on partage (sur LinkedIn) #ByebyeTwitter #BisousElon

Bonus : Bienvenue dans l’ère de l’Internet « post-naïf » - Et dans la « casino economy » – Mais pas de panique, le PDG de Nvdia affirme que nous ne sommes pas dans une bulle… Ouf ! – Même si d’autres nous expliquent que le crash arrive – Remplacer les humains par l’IA, est-ce vraiment une bonne idée ? – Pendant ce temps, ChatGPT, Gemini, Grok et Deepseek diffusent de la propagande russe – Et Meta utilise du porno pour entraîner son IA – Trump lance Truth Predict, une plateforme pour parier sur les futures élections – Teams va désormais poucave à votre boss - Mégasurprise, l’électricité verte de Google, Meta ou Amazon ne l’est pas franchement - Plus d’un million de personnes parleraient de suicide à ChatGPT, selon Open AI - Le soleil à la demande pour les riches, ça vous dit ? – Vous vous rappelez du site qui affichait toutes les infos personnelles des détracteurs de Charlie Kirk ? Ses créateurs sont visiblement partis avec la caisse - Oups, une erreur s’était glissée dans la dernière édition de la NL, dans la news concernant le télétravail : voici l’étude dont on vous parlait – Et pour finir, un jardin collaboratif où tout le monde peut planter ses fleurs <3 - La suite… la semaine prochaine !

Nota Bene : si jamais vous recevez ce mail alors que vous vous étiez déjà désincrit·e il y a quelque temps, si vous le recevez en double, si vous avez l’impression de ne plus recevoir Tech Trash, ou encore que votre newsletter favorite arrive désormais dans les spams, n’hésitez pas : écrivez-nous à hello@techtrash.fr. On répond à tout le monde (même si ça peut mettre quelques jours), requêtes, questions, mots d’amour… promis 😘